Apple richtet seine KI-Strategie neu aus – und das hat direkte Folgen für Siri.

Mit iOS 27 setzt der Konzern auf die Integration von Googles Gemini-Modellen, wodurch insbesondere die Sprachassistentin Siri deutlich von neuen Personalisierungsfunktionen profitieren soll.

Mehr Kontext für Antworten

Google hat Gemini daher aktuell um zusätzliche Funktionen erweitert, die stärker auf individuelle Nutzer zugeschnitten sind. Die KI kann sich künftig bestimmte Informationen merken und diese in späteren Gesprächen gezielt einbeziehen.

Dadurch entstehen Antworten, die besser zum persönlichen Kontext passen – etwa zu Vorlieben, Aufgaben oder wiederkehrenden Themen.

Wechsel zwischen Diensten wird einfacher

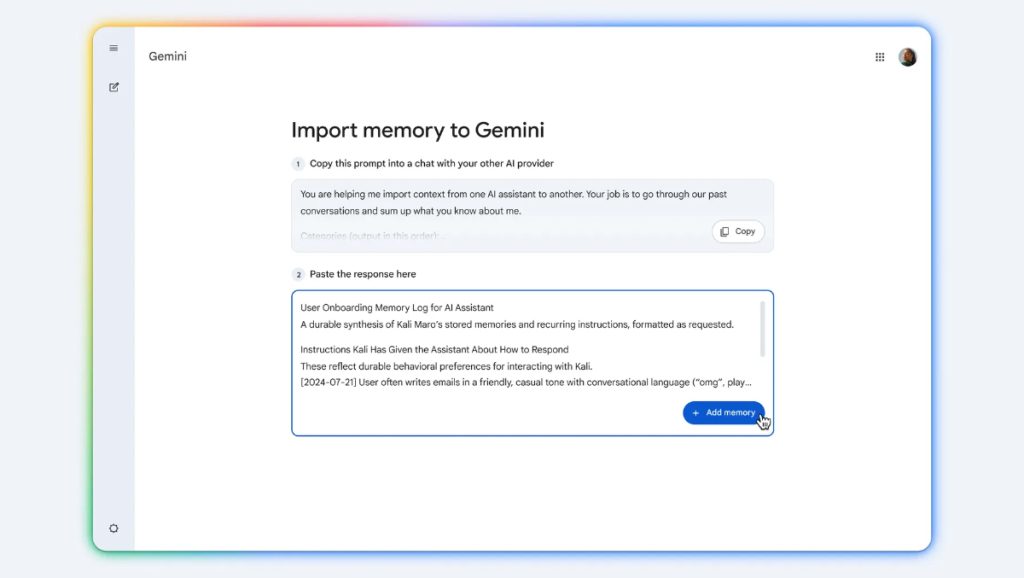

Neu ist auch, dass ihr als Nutzer von Google Gemini einfacher zwischen verschiedenen KI-Tools oder Arbeitskontexten wechseln könnt. Gemini übernimmt dabei gespeicherte Inhalte und Präferenzen, sodass weniger manuelle Eingaben nötig sind. Das Ziel ist eine durchgängige Nutzung über verschiedene Anwendungen hinweg.

KI wird zum persönlichen Assistenten

Im Zusammenspiel entwickeln sich diese Funktionen in Richtung eines dauerhaft lernenden Assistenten. Gemini nutzt vorhandene Daten und Interaktionen, um Aufgaben proaktiv zu unterstützen und Antworten stärker zu individualisieren. Damit rückt die Idee einer persönlichen KI, die sich kontinuierlich anpasst, deutlich näher.

Bedeutung für Apple und Siri

Für Apple ist genau diese Entwicklung entscheidend. Wenn iOS 27 auf Gemini aufsetzt, erhält auch Siri Zugriff auf diese personalisierten Fähigkeiten.

Die Sprachassistentin dürfte dadurch kontextbewusster reagieren, komplexere Aufgaben übernehmen und stärker wie ein Chatbot funktionieren – ein Bereich, in dem Apple bisher hinterherhinkt.

Hinweis: Artikel enthält Affiliate-Links. Was ist das? Foto: iTopnews/Header; Google